Künstliche Intelligenz: Hoffnung oder Verderben

Beginnen wir mit der Hoffnung. Die Welt erlebt gerade einen aufregenden Moment, vergleichbar mit jenem des Jahres 1993, als das World Wide Web für die Öffentlichkeit freigegeben wurde; oder vielleicht sogar mit jenem vor 32.000 Jahren, als der Mensch entdeckte, wie man Feuer macht. Heute ist es die Entwicklung der künstlichen Intelligenz, die sich explosionsartig verbreitet und Utopien anfacht, die alles auf den Kopf stellen.

Das Leben wird dank künstlicher Intelligenz einfacher, interessanter, weniger beschwerlich. In allen Bereichen der Forschung, der Technik und des Alltags finden Revolutionen statt. Manche Innovationen sind bereits erprobt, andere stehen vor der Tür, wieder andere sprengen unsere Vorstellungskraft. Die fahrerlosen, unfallfreien Autos! Die blitzartig erstellten Gebrauchstexte aller Art! Die viel schnelleren und verlässlicheren Krankheitsdiagnosen! Die eilfertige Erledigung aller Jobs, die kein Mensch jemals gern gemacht hat!

Alles wird besser. Und nebenbei auch noch lustiger! Die Fotos von Papst Franziskus im todschick taillierten weißen Daunenmantel mit Kapuze, die alle Plattformen überschwemmten, waren bloß ein vager Vorgeschmack dessen, was alles möglich sein wird, wenn künstliche Intelligenz sich mit Entertainment paart.

Doch während das Social-Media-Universum noch über Franziskus’ Bling-Bling-Style kicherte, erreichte die Nachrichtenagenturen eine ziemlich humorlos formulierte, eindringliche Warnung: Führende Persönlichkeiten von Technikkonzernen wie Apple und OpenMinds, Forscherinnen und Forscher, Prominente wie der Bestsellerautor Yuval Noah Harari oder Tesla- und Twitter-Eigentümer Elon Musk fordern darin einen Stopp bei der Entwicklung von Systemen künstlicher Intelligenz von sechs Monaten. Ihre Begründung für diesen aufsehenerregenden Schritt ist in eine rhetorische Frage verpackt: „Sollen wir nicht-menschliche Gehirne entwickeln, die uns eines Tages zahlenmäßig überlegen sein könnten, schlauer als wir sein könnten und uns überflüssig machen und ersetzen könnten?“

Spätestens hier endet auf abrupte Weise die hoffnungsfrohe Geschichte über die künstliche Intelligenz, und es beginnt die des möglicherweise unausweichlichen Verderbens.

Vielleicht erlebt die Welt nämlich derzeit einen der heikelsten Momente, vergleichbar mit dem am 16. Juli 1945, als in New Mexico die allererste Atombombe gezündet wurde und Robert Oppenheimer, der Leiter des Projekts, einen Vers aus der hinduistischen Schrift „Bhagavad Gita“ zitierte: „Nun bin ich der Tod, der alles raubt. Erschütterer der Welten.“

Hoffnung oder Gefahr

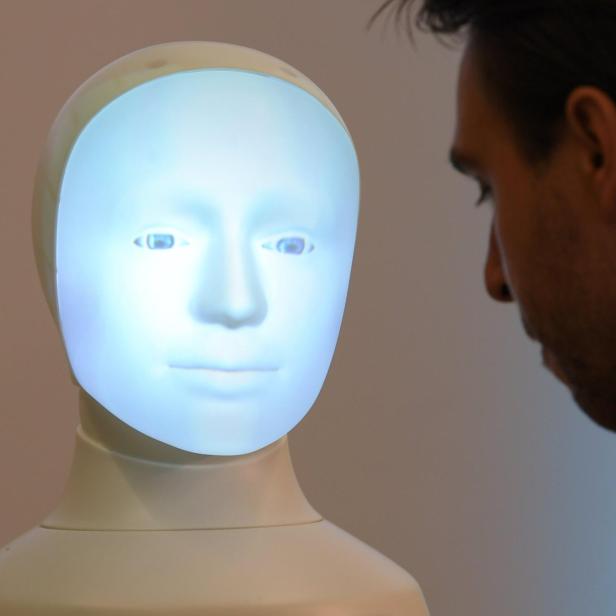

Haben die Entwickler von künstlicher Intelligenz tatsächlich etwas in die Welt gesetzt, das die Menschheit in existenzielle Gefahr bringen kann? Und wie kann man sich diese Bedrohung vorstellen?

Martin Welz, Professor am Institut für Biomedizinische Bildanalyse an der Tiroler Privatuniversität Umit, ist einer der Erstunterzeichner des offenen Warnbriefes. Im Gespräch mit profil sagt er: „Die Gefahr der Auslöschung der Menschheit durch künstliche Intelligenz ist nicht ausgeschlossen. Es liegt an uns, das zu verhindern.“ Ein solch apokalyptisches Szenario residiert noch nicht in der Realität, sondern im Bereich des Denkmöglichen. Welz skizziert, wie der Pfad dorthin aussehen könnte: „Die Gefahr besteht darin, dass künstliche Intelligenz Entscheidungen treffen könnte, die nicht von Menschen autorisiert und kontrolliert werden. Oder auch darin, dass künstliche Intelligenz menschliche Akteure manipuliert.“

Die Schwierigkeit dabei, eine solche Gefahr einzuschätzen, besteht unter anderem darin, dass niemand vorhersagen kann, wozu Künstliche-Intelligenz-Systeme schon bald in der Lage sein werden. Die Forschung schreitet so ungeheuer schnell voran, dass auch Wissenschafter wie Welz ins Staunen geraten. Bereits jetzt können täuschend real aussehende Bilder, Videos oder auch Meldungen produziert werden, die schlimmstenfalls unbemerkt den Weg in Nachrichtenkanäle finden könnten. Weil die Fakes immer perfekter werden und deren Verbreitung immer subtiler wird, liegt es im Bereich des Möglichen, dass eine unkontrollierte KI-Kampagne eine Gesellschaft destabilisieren könnte.

Auch soziale Probleme könnten explodieren. „Sollen wir alle Jobs wegautomatisieren, auch die erfüllenden?“, heißt es im offenen Brief. Je effizienter die künstliche Intelligenz wird, umso weniger werden Menschen gebraucht. Angesichts des derzeitigen Arbeitskräftemangels scheint das kein noch großes Risiko, doch die Experten sehen offenbar eine rasante Entwicklung voraus.

Klar ist jetzt schon, dass in sinnvollen Erfindungen oft Gefahren schlummern. Ein Beispiel: Eine KI-Software soll in der Lage sein, an Parametern der Stimme – der Sprechmelodie, der Pausen, der Betonung – zu erkennen, in welchem psychischen Zustand sich jemand befindet. Beginnende Depressionen oder Schizophrenie können so frühzeitig aufgespürt werden, kombiniert mit einem Warnsignal, das an eine Gesundheitshotline gesandt wird.

Eine nützliche Sache – außer natürlich, diese Technologie wird von Unbefugten und ohne Wissen der untersuchten Person eingesetzt. Dann handelt es sich um einen schweren Eingriff, der für den Betroffenen schlimme Folgen haben kann.

Neue Gesetze gesucht

Die sechsmonatige Entwicklungspause, die im offenen Brief gefordert wird, soll es Regierungen ermöglichen, Regeln für Künstliche-Intelligenz-Anwendungen zu erstellen, um die beschriebenen Gefahren einzudämmen. Keine einfache Sache, für die sechs Monate wohl nicht ausreichen. Die Europäische Union hat im April 2021 den Gesetzesvorschlag „Artificial Intelligence Act“ vorgelegt, der immer noch verhandelt wird – allerdings ist der Text von der Realität bereits überholt. Der Plan ist, schädliche KI-Software wie etwa Sozialkredit-Systeme (die Bewertung einer Person auf Basis ihres Verhaltens), Fälschungssoftware oder bestimmte Gesichtserkennungsanwendungen zu verbieten. Allerdings erweist sich ein Programm wie das textbasierte Dialogsystem ChatGPT als so vielfältig, dass das vorgeschlagene Gesetz darauf nicht anwendbar ist.

Die italienische Regierung hat nun den Zugriff auf diesen Chatbot kurzerhand verboten. Darin äußert sich eine weitere Gefahr der KI: aufkommende Technologiefeindlichkeit. Weil die neuen Errungenschaften vielen unheimlich sind und Ängste erzeugen, wohin all das führen könnte, versucht man, die Innovation zu stoppen.

Das ist erstens unrealistisch und zweitens auch nicht das Ziel der Unterzeichner des offenen Briefes. Universitätsprofessor Welz sagt, er und seine Mitstreiter plädierten „nicht für eine Einstellung der Forschung, sondern für ein sechsmonatiges Moratorium“.

Internationale Regeln für die künstliche Intelligenz zu finden, ist alles andere als einfach. Was in China staatlich erwünscht ist, gilt in Europa als Verletzung der Grundrechte. Nun hat die internationale Gemeinschaft neben altbekannten kniffligen Problemen wie der Kontrolle der Atomwaffen und neueren Kopfnüssen wie der Klimadebatte ein brandaktuelles dazubekommen – die KI.

Wenn sie es richtig anpackt, winken nicht nur enorme ökonomische Möglichkeiten, sondern auch eine höhere Lebensqualität. Womit wir wieder bei der hoffnungsvollen Variante der Erzählung wären.