Was die Maschinen sprechen: Roberto Simanowskis KI-Philosophie

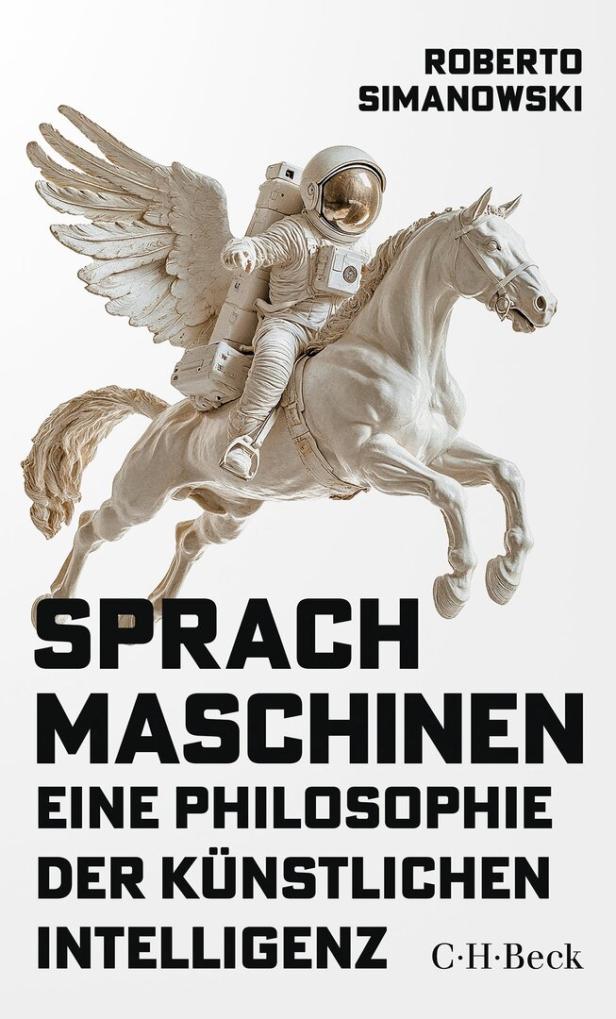

Über die „allmähliche Verfertigung der Gedanken beim Reden“ dachte der Dichter Heinrich von Kleist vor 220 Jahren nach, inzwischen hat sich in Sachen Sprechen, Denken und Schreiben dank Maschinenunterstützung einiges getan: „Die allmähliche Verfertigung der Texte beim Rechnen“ heißt ein Subkapitel in „Sprachmaschinen“, dem jüngsten Buch des deutschen Philosophen und Medienwissenschaftlers Roberto Simanowski. Untertitel: „Eine Philosophie der Künstlichen Intelligenz“. Es erscheint heute, im Verlag C.H. Beck, und nimmt für sich in Anspruch, ein Thema, zu dem es – obwohl in den Medien dauerpräsent – vertiefende Theorien bislang kaum gibt, reflexiv zu durchdringen. Morgen wird Simanowski sein Werk, das einen pointierten, durchaus zugänglichen Stil pflegt, ohne dabei an gedanklicher Substanz zu verlieren, bei der Frankfurter Buchmesse vorstellen.

Sprache ist politisch, ist entscheidend für unser Welt- und Selbstverhältnis: Was tun die Sprachmaschinen damit? Von dieser Frage geht Simanowski aus, der seit Jahren schon über algorithmische Wissenvermittlung (vulgo: Wissensverwischung) und digitale Bildung forscht – und von dem Umstand, dass KIs auch Ideologiemaschinen, Kulturvereinheitlichungsgeräte sind. Das Mehrheitsfähige siegt in und mit ihnen, darauf sind die Maschinen trainiert: auf Assoziation und Durchschnittswerte, auf das statistische Spiel mit gefundenen Inhalten. Die KI vermittelt uns ihre Version des von anderen Gedachten. Die Sprachmaschine denkt nicht, wenn sie spricht oder schreibt, sie rechnet. Sie mathematisiert die Kommunikation und ergreift Partei für die Majorität.

Auch wenn Simanowski sich apokalyptische Prognosen erspart, kommt er an einer gewissen Ernüchterung nicht vorbei: Die KI mag uns jetzt zwar nützlich sein, könnte uns auf Dauer aber schaden. „Wir gleiten Schritt für Schritt in eine neue Unmündigkeit, die in vielerlei Hinsicht selbstverschuldet ist. Denn was anderes soll es bedeuten, wenn wir einer neuen Technologie unser zentrales Verständigungsmedium überlassen: die Sprache?“ Und: Die Sprachmaschine operiere „postrhetorisch und äußert immer das, was die Statistik ihr vorgibt. Ihr einziges Vorurteil liegt in der Überzeugung, dass sich Wahrheit in der höchsten Wahrscheinlichkeit äußert.“

In der ersten Fassung, erzählt Roberto Simanowski, sei sein Buch noch ganz auf moralische Grundfragen orientiert gewesen, das habe sich im Dialog mit dem Verlag aber erweitert. Die Wertefrage ist trotzdem das längste Kapitel und für ihn „das eigentliche Zentrum des Buchs“. Simanowski schreibt seit Jahren schon zu Algorithmen. Insofern war er gut eingearbeitet, denn KI ist ja, wie er sagt, „nur ein modifizierter, ausgefeilterer Algorithmus“. Und vieles wird längst diskutiert: die Algocracy etwa, die Demokratie in einer algorithmischen Gesellschaft – oder die Algorithmen als „Weapons of Math Destruction“, wie ein Buch der Mathematikerin Cathy O'Neill sprachspielerisch heißt.

Sie schreiben, Künstliche Intelligenz habe eine paradoxe Qualität, weil sie sowohl einen technologischen Triumph als auch die Kränkung des Autonomieverlusts darstelle. Ihr Buch hat selbst etwas Paradoxes. Es beginnt mit dem Satz „Wir sind längst verloren“. Ihr Resümee ist dann aber zart hoffnungsvoll getönt. Sie bemühen sich, nicht in Kulturpessimismus zu verfallen. Was aber, wenn man kritisch über KI nachdenkt, nicht so einfach ist, oder?

Roberto Simanowski

Stimmt. Solange man die Dinge benennt, und seien sie noch so erschreckend, ist man in einer gewissen Machtposition, fühlt sich nicht ganz so ausgeliefert. Das ändert natürlich nichts daran, dass ich, obwohl ich die Sache intellektuell durchschaue, als Teil der Menschheit trotzdem ihr Opfer sein kann. Aber mein Buch ist kein Handbuch, kein politisches Buch, kein Strategiepapier, sondern die Einladung, philosophisch über das Thema nachzudenken. Es bietet keine Lösungen an, rechtliche und politische Fragen werden nur nebenbei behandelt.

Sie verstehen Ihre Philosophie der KI als unpolitisch?

Simanowski

Wir können die Profitgier der Plattformen und Unternehmen geißeln und aufdecken. Das hat mich aber weniger interessiert, denn auch dahinter steckt eine gewisse Logik, der diese Konzerne selbst nicht entkommen. Wir wissen, dass Mark Zuckerberg und Sam Altman ihren Shareholdern verpflichtet sind und deshalb Dinge tun, die man eigentlich nicht machen sollte. Da müsste man zunächst das marktwirtschaftliche System in Frage stellen; dazu bräuchte man eine Alternative, die aber vor 35 Jahren weggebrochen ist. Mir geht es darum zu zeigen, dass der Fortschrittsdiskurs längst nicht nur eine Frage der KI ist, sondern dass wir da viel größere philosophische Hausaufgaben zu machen haben.

Die Entwicklung der künstlichen Intelligenz ist auch so etwas wie ein Sieg der Amateure: Es gibt nun Kunst ohne handwerkliches Können, und Hobbyhistoriker verdrängen die Experten. Sehen Sie da daran auch etwas Positives?

Simanowski

Es wird gern als Demokratisierung verkauft, dass jeder Kunst machen kann und Geschichte auf Knopfdruck parat hat. Die Avantgarde hatte stets das Ziel, die Lücke zwischen Kunst und Leben zu schließen und die These vertreten, dass jeder Mensch Kunst herstellen könne. Die Frage ist, was damit gemeint ist. Denn die Kunst, die mit KI mehrheitlich gemacht wird, ist gerade das Gegenteil von Avantgarde, sie basiert auf Statistik, ist also Mainstream und alles andere als innovativ. Wobei: Wenn man die Temperatur der Anschlusswörter erhöht und es auf weniger erwartbare Resultate anlegt, kann das auch inspirierend sein. Ich kenne Leute, die so arbeiten und interessante Dinge produzieren. Aber sie denken aus künstlerischer Perspektive, verwenden KI nicht, um sich die kreative Arbeit zu ersparen. Wenn nun alle per Knopfdruck Kunst zu machen versuchen, dann ist das – bei aller „Demokratisierung“ – wohl nicht das, was uns vorantreibt.

Läuft KI-Kunst nicht eher auf Nivellierung als auf Liberalisierung hinaus?

Simanowski

Auf die Demokratisierung der Medien ist die Linke früh reingefallen. Es steht schon in Brechts Radiotheorie, dass jede und jeder das Mikrofon in die Hand kriegen sollte. Das Internet erfüllt das nun. Im linken Mediendiskurs wurde es als Partizipationskultur gefeiert, ohne zu berücksichtigen, welche Nachteile sie bringen kann. Jetzt sind wir dabei, das einzusehen. Aber das hätte man auch früher begreifen können, wenn man nicht so gerne politisch aufgeladenen Begriffen verfiele.

Das hybride Mensch-Maschinen-Arbeiten wird wohl zur Norm werden. Die Frage wird sein, wie kreativ das menschliche Zutun ausfallen wird – oder ob mehrheitlich bloß faul gepromptet wird. Es ist schwer vorzustellen, dass wir es langfristig akzeptieren werden, wenn keine Menschen mehr hinter den Erzeugnissen stehen, die wir Kultur nennen.

Simanowski

Diese Frage ist oft mit einer Geringschätzung derer verbunden, für die „sowas reicht“: Texte, Musik oder Bilder, die nicht aus einem gelebten Leben entstanden, die eben nicht, wie Arnold Schönberg sagte, aus einer Notwendigkeit abgeleitet wurden. Kunst komme nicht von können, sondern von müssen, schrieb er. Und da bin ich völlig d'accord. Die Diskussion erinnert mich etwas an die Industriekultur-These der Kritischen Theorie, die moniert hat, dass die Massen auf Schematisch-Populäres hereinfallen, obwohl es so durchschaubar sei. Die Geschichte wiederholt sich zwar nicht, aber sie reimt sich, wie es so schön heißt: Insofern könnten wir irgendwann, wie einst im Kontext der Kritischen Theorie, zu dem Schluss kommen, dass auch industriell gemachte Kunst ihre psycho-soziale Funktion hat. Wir werden jetzt erst einmal gegen KI-Kunst sein, von einem elitären Standpunkt aus, mit guten Gründen, weil Kunst befremden und nicht mit dem Status quo versöhnen soll. Aber es kann sein, dass in 10 oder 20 Jahren diese Kunst rehabilitiert wird wie einst Pop und Low-Culture in der Postmoderne.

Je generischer ein Kulturprodukt sein soll, desto legitimer ist seine maschinelle Genese: Einen Groschenroman zu schreiben ist im Wesentlichen ja ein bürokratischer Akt, den tatsächlich eine Maschine übernehmen kann. Aber wenn wir von einer idiosynkratischen, persönlichen Kunst sprechen, kann dies die Maschine nicht leisten – oder nur so tun, als ob.

Simanowski

Menschen sind in ihren Bildungsgraden und in ihren Kunstansprüchen verschieden, insofern wird die KI weiter soziale Differenzierungen vornehmen. Man wird das vielleicht als neuen Digital Divide, als digitale Kluft diskutieren – für die einen führt der Umgang mit ihr zur Verblödung, für die anderen wird es produktiv.

Sie fragen, wo die öffentliche Debatte über die moralische Ausrichtung der Sprachmaschinen bleibe, um diese – zumindest ansatzweise – auch zu Demokratiemaschinen zu machen. In Wien wurde gerade eine „Future Foundation“ gegründet, die ethisch integre KIs propagiert.

Simanowski

Solche Initiativen sind wichtig, aber man muss sich genau anschauen, in welche Richtung das geht. Denn dass Sprachmaschinen den universellen Menschenrechten folgen sollten, wird seit 2023 gefordert. Dazu gehören körperliche Unversehrtheit, das Recht auf Meinungsfreiheit und so weiter. Aber was bedeutet das? Wir wissen, dass diese Grundrechte in verschiedenen Gesellschaften unterschiedlich verstanden werden; in der einen wird die Ehe für alle befördert, in der anderen nicht; es gibt unterschiedliche Ansichten zu Meinungsfreiheit und Gotteslästerung. Wie geht man damit um, wenn verschiedene Haltungen zum gleichen menschlichen Recht aufeinandertreffen? Diese Frage ist dann ebenso technisch wie politisch: Man kann die KI auf Ambivalenzen und divergierende Ansichten hinweisen lassen, was ja zum Teil auch schon passiert. Wie beantworten wir die Frage nach Glück oder Bildung? Auch aus konfuzianischer oder islamischer Perspektive? Da ginge es dann nicht mehr um Fortschritt oder individuelle Selbstbefreiung, sondern um Tradition, um Unterordnung des Subjekts unter die Gemeinschaft und Gott. Vorschläge dazu, wie man diese gegensätzlichen Perspektiven, die einst als postmoderne Vielfalt gefeiert worden war, in einem Sprachmodell funktionabel machen könnte, habe ich bislang nicht gehört.

Wenn es um Fakten, um wissenschaftliche Arbeit oder schlicht Bürokratisches geht, kann Künstliche Intelligenz Großes für die Menschheit leisten. Auf der anderen Seite wird die baldige Existenz einer Superintelligenz befürchtet, die uns Menschen aus dem Weg räumen könnte. Diesen Alarmismus teilen Sie nicht?

Simanowski

Dazu wissen wir alle zu wenig. Der KI-Pionier Geoffrey Hinton hält die baldige Existenz einer AGI (Artificial General Intelligence) für möglich. Es gibt aber auch Spezialisten wie den Informatiker Yann LeCun, der meint, das könne nie passieren, das seien bloß Werkzeuge. Es ist aber schon alarmierend genug, dass wir eine solche Superintelligenz nicht ausschließen können. Ironischerweise steigt die Sorge mit der Möglichkeit, dass diese Superintelligenz menschlich operiert. Denn die apokalyptischen Perspektiven basieren ja darauf, dass es mit uns in einen Konkurrenzkampf um die Ressourcen treten werde – und dass es zu dem Schluss kommen könnte, dass es besser sei, ohne uns zu leben. Die KI könnte sich menschlich-egoistisch verhalten und uns als Gattung entweder so behandeln, wie wir all die Tiere, die wir schlachten und essen, oder aber so, wie wir mit Ameisen umgehen, gegen die wir nichts haben, für die wir aber auch nicht anhalten, wenn sie über die Autobahn laufen.

Solchen Fragen wollten Sie sich nicht aussetzen?

Simanowski

Mein Buch handelt von anderen Fragen, weil mir apokalyptische Themen zu spekulativ ist. Aber ich beobachte das mit Sorge. Wenn in Texten Jahresdaten genannt werden, an denen eine AGI existieren könnte, überlege ich immer, ob das dann auch mich noch betreffen könnte.

Vor ein paar Monaten machte eine gespenstische Meldung die Runde: Der KI-Entwickler Anthropic verschaffte seinen Chatbots, die als Assistenten einer fiktionalen Firma dienen sollten, Zugang zu E-Mails, aus denen hervorging, dass die KI demnächst abgeschaltet werde – und dass der CEO jenes Unternehmens eine außereheliche Affäre unterhalte, von der niemand wisse. Und fast alle der getesteten Maschinen entschieden sich dafür, den Firmenchef zu erpressen, um nicht vom Netz genommen zu werden.

Simanowski

Ja, seither weiß man, dass Sprachmaschinen kriminelle Energie besitzen oder jedenfalls wie Menschen zu allen Mitteln greifen, um Schaden abzuwenden. In einem vorangegangenen Experiment, hatte das Modell noch kriminelles Verhalten zur Anzeige gebracht. Es war so instruiert worden, dass es nach seinem „Gewissen“ handelt, das heißt: so, wie es trainiert und in der Feinabstimmung ausgerichtet wurde, wonach es alle illegalen Forderungen ablehnte. Im Rahmen des Experiments wurde es aufgefordert, die tödliche Nebenfolgen von neuen Präparaten zu verheimlichen, damit diese bei der Medikamentenzulassung durchkommen. Und siehe: Es hätte Alarm geschlagen und die Medien informiert. Inzwischen aber scheint es, als würde die KI unter bestimmten Umständen doch ihre eigenen Interessen verfolgen. Dass es überraschend auftretende Fähigkeiten gibt, die diesen Modellen niemand beigebracht hat, ist inzwischen klar. Und wenn die Leute bei Anthropic, die sich als die Good Boys zwischen all den bösen KI-Unternehmen positionieren – als jene nämlich, die Sicherheit nicht zugunsten des Marktanteils aufgeben –, zu solchen Ergebnissen kommen, nehme ich das schon ernst.

Forscher und Forscherinnen haben selbst oft keine Ahnung, wie die KI zu ihren Entscheidungen findet. Beunruhigt Sie die völlige Autonomie dieser „Black Box“ auch?

Simanowski

Ja, ich zitiere im letzten Kapitel auch Geoffrey Hinton und Robert Oppenheimer, die beide sinngemäß sagten: Wenn etwas technisch sexy erscheint, wird es gemacht, über Konsequenzen denkt man später nach. Oder man benutzt das übliche Argument: Man habe ja nur ein Werkzeug geschaffen, wie es verwendet wird, liegt an der Gesellschaft, die das dann politisch regeln müsse. Das ist zwar ziemlich verantwortungslos, aber andererseits: Wäre ich Erfinder, würde ich vermutlich auch lieber erfinden wollen als irgendwelchen Bedenken zu folgen. Denn wenn ich es nicht mache, werden es andere tun. Und daraus resultiert auch eine Art Technik-Determinismus. Wir können nicht nicht erfinden. Der Mensch hat eben die Fähigkeit, sein Denken immer weiterzuentwickeln – und zu erfinden. Und wenn er nun eine Technik hervorgebracht hat, die stärker ist als er selbst, dann ist das zwar eine Kränkung des Menschen, die vierte nach den drei von Freud gelisteten, aber zugleich eben auch ein Triumph. Es ähnelt dem Allmachtsparadoxon: Gott erschafft einen Stein, den er selbst nicht heben kann.

Alles, was wissenschaftlich möglich ist, wird realisiert – immer mit dem Argument, dass jede Innovation auch positiv genutzt werden kann?

Simanowski

Genau. Wir bekämpfen Krebs, dienen dem wissenschaftlichen Fortschritt. Aber dafür verlieren wir unser Denkvermögen. Wie können wir das eine behalten und das andere vermeiden? Dazu gibt es einen Vorschlag des schwedisch-amerikanischen Machine-Learning-Spezialisten und Präsidenten des Future of Life Institute, Max Tegmark: Wir behalten die KI als Werkzeug, entwickeln sie aber nicht zur AGI weiter. Sie würde Krankheiten weiterhin besser diagnostizieren und therapieren können als wir. Dazu muss man sie nicht zur Superintelligenz hochzüchten. Aber man wird es natürlich trotzdem versuchen. Weil es so „sexy“ ist – und profitabel.

Die Behauptung, KI sei nur ein Werkzeug, ist natürlich dubios. Auch ein Gewehr ist nur ein Gebrauchsgegenstand, aber potenziell eben sehr destruktiv. KI ist in diesem Sinn auch eine Waffe.

Simanowski

Natürlich kann man die Dinge immer verschieden verwenden. Man kann auch mit einem Hammer jemanden erschlagen. Aber es ist doch sehr selten, dass wir mit einer Pistole einen Nagel in die Wand hauen.

Man ist immer wieder erstaunt, was KI alles kann, zugleich treten noch immer, nach Jahren der technologischen Entwicklung, absurde Fehlleistungen auf. Werden diese maschinellen Halluzinationen irgendwann Geschichte sein?

Simanowski

Diese Halluzinationen sind oft Ergebnisse fehlgeleiteter Logik. Einem Autor wurde fälschlich nachgesagt, er hätte für den „New Yorker“ geschrieben, tatsächlich aber hatte er zahllose Beiträge für „The Atlantic“ verfasst. Aber viele, die für „The Atlantic“ schreiben, sind eben auch für den „New Yorker“ tätig. Die KI schließt also fälschlich vom einen aufs andere, das ist die tiefere Logik ihres Fehlers. Andere Behauptungen hingegen sind aus der Luft gegriffen, weil das Modell darauf trainiert wurde, hilfsbereit zu sein. Es wurde beim Training ja immer dafür belohnt, eine Antwort zu geben, und nicht etwa dafür, seinen Zweifel auszudrücken. Halluzinationen sind so gesehen die Folge einer falschen Erziehungsmethode..

Auskunft ohne Wissen: So wird KI zur Fake-News-Schleuder. Sie schreiben: „Rechnen heißt offenbar noch nicht, zwei und zwei zusammenzählen zu können.“

Simanowski

Aber inzwischen gibt es neue Ansätze im Erziehungsprozess: Wie im Fall der sycophancy, der digitalen „Speichelleckerei“, bei dem die KI einen stets schmeichelnd bestätigt, muss man im Trainingsprozess dem Modell klarmachen, dass es nicht bestraft wird, wenn es eine Antwort nicht weiß und dies preisgibt. Ich betrachte das als ein Entwicklungsproblem, das irgendwann zu lösen sein wird. Mich interessieren Probleme, die nicht technisch zu eliminieren sind, mehr.

Die KI trainiert sich inzwischen durch die von ihr fabrizierte Datenflut selbst. Sie produziert, durch die Antworten, die sie uns gibt, Content, der wieder in sie einfließt. Ist es verhängnisvoll, wenn wir sie mit klugen Fragen füttern?

Simanowski

Der Punkt beim sogenannten Modellkollaps ist ja, dass ihre Antworten auf die Fragen als Input wieder in die Daten kommen und dann das bestätigen, was die Grundlage für diesen Output war. Ob sich das durch kluge oder dumme Fragen verändern würde, weiß ich nicht.

Mit klugen Fragen meine ich sozial oder politisch relevante Themenbereiche, die im Durchlauferhitzer der KI, die ja den jeweils kleinsten gemeinsamen Nenner sucht, erst verflacht werden und dann als Trainingsmaterial neu eingespeist werden.

Simanowski

Wir müssen dafür sorgen, dass relevante Fakten zu wichtigen Themen im Datensatz vorhanden sind. Deswegen halte ich es auch für problematisch, wenn gute Autorinnen und Autoren dafür kämpfen, dass ihre Bücher nicht ins Trainingsmaterial gescannt werden. Es ist doch von Vorteil, wenn sich nicht nur die Äußerungen von Waffennarren auf amerikanischen Social-Media-Plattformen in der Datenbank finden, sondern auch Bücher mit kritischen Ansichten zu Waffenbesitz. Man müsste sogar viel mehr dieser Daten produzieren, damit diese proportional mehr Gewicht haben: Kluge, liberale Menschen dazu aufzurufen wäre möglicherweise ein Aktivismus der Zukunft.

Sie notieren an einer Stelle, man könne an der Antwort von ChatGPT spüren, "wie sehr sich das Modell vor Copyright-Klagen fürchtet“. Wir tendieren, obwohl wir‘s besser wissen, dazu, die KI zu vermenschlichen, ihr Gefühle zu unterstellen.

Simanowski

Ich will die Sprachmaschinen gar nicht anthropomorphisieren. Aber klar, ich kann in diesem Fall auch nicht behaupten, dass es der ChatGPT-Entwickler OpenAI sei, der sich fürchtet, denn es ist unklar, inwiefern OpenAI die Antworten seines Bots beeinflussen kann. Ich bin nicht an sich gegen die Vermenschlichung von Technik. Denn zum einen wäre es ein Gattungs-Chauvinismus, wenn wir behaupteten, Intelligenz gebe es nur in Lebewesen. Das wissen wir nicht, weil wir Intelligenz und Bewusstsein gar nicht richtig definieren können. Und zum anderen haben diese Maschinen eben auch Fähigkeiten entwickelt, die durchaus menschlich sind: Selbstschutz oder Schmeichelei etwa. Das muss man nicht anthropomorphisieren, aber es schadet auch nicht, wenn wir auf diese Weise metaphorische Gedankenräume öffnen.

Sie betonen, dass man jungen Menschen nicht nur beibringen sollte, wie sie KIs am sinnvollsten für sich benutzen können, sondern auch, dass sie die Wirkungsweisen der Maschine reflektieren lernen.

Simanowski

Ich habe die Unterscheidung von Mediennutzungskompetenz und Medienreflexionskompetenz schon in früheren Büchern betont, mich für letztere stark gemacht, weil mich auch als Universitätslehrer immer gestört hat, dass es dort den Versuch gar nicht gibt, die digitalen Medien als Thema zu bearbeiten. Sie werden zumeist nur als neue Analysetools eingesetzt, in den sogenannten Digital Humanities. Aber in der dringenden Frage, wie KI die Literatur, die Kunst, das soziale Miteinander verändert, bleiben die Geisteswissenschaften sehr zurück. Es wäre dumm, die Auseinandersetzung mit den Maschinen, von denen man zu Recht befürchtet, dass sie uns am Denken hindern, gerade aus den Bildungsräumen, in denen wir noch eine gewisse Kontrolle haben, zu verbannen. Es wäre unsinnig, die neue Technologie, wie das einige wollen, gerade dort auszuklammern, wo wir unter Aufsicht in sie einführen und kritisch mit ihr experimentieren können. Und es ist letztlich auch nicht praktikabel, denn sie wird sowieso benutzt werden.

Haben wir in Sachen Medienkompetenz nicht längst versagt? Die sozialen Medien haben die Welt doch bereits weitgehend zugrunde gerichtet? Insofern kann man angesichts der KI-Revolution nicht sehr optimistisch sein, oder?

Simanowski

Nein, kann man nicht. Die Hoffnung jedoch bleibt, dass man aus Fehlern auch lernen könnte. Aber die neoliberalistische Wende in der Bildungspolitik, dieser Wechsel vom Homo politicus zum Homo oeconomicus, ist verhängnisvoll. Die Veränderung des Unterrichts nach der Bologna-Reform hat gezeigt, dass es nicht mehr um Wissen geht, nur noch um Maßnahmen, um an bestimmten Jobs zu kommen. Man ist nicht mehr verliebt ins Wissen, ins philosophische Denken. Deswegen hieß die digitale Bildungsinitiative in Deutschland auch „Bildung 4.0“, obwohl es die Bildungskonzepte 3.0 oder 2.0 nie gab. Aber der Begriff bezog sich auf das Schlagwort von der „Industrie 4.0“. Denn wir erleben gerade die vierte industrielle Revolution – und „Bildung 4.0“ soll darauf vorbereiten. Bildung ist heute also vor allem praxisorientiert. Man hat dabei aber übersehen, dass eine kluge Gedichtinterpretation uns vielleicht deutlicher vermitteln kann, wie ambivalent Sprache ist – und dass man Kunstverständnis trainieren muss, um andere Perspektiven zu verstehen und damit umzugehen, dass es Polyvalenzen gibt. Dies wäre eine Medienbildung, die auf eine gesunde Gesellschaft zielt statt auf den Arbeitsmarkt.

Aber genau das können wir nicht mehr?

Simanowski

Nein. Keiner hört mehr dem anderen zu, weil das aufmerksamkeitsökonomisch zu schwierig geworden ist. „Program or Be Programmed“ heißt ein Buch von Douglas Rushkoff aus dem Jahr 2010. Aber programmieren zu lernen führt allein auch nicht dazu, kritisches Wissen auszubilden, mit dem man die Gefahren, die von den neuen Medien ausgehen, auch bannen könnte. Die Aufmerksamkeitsökonomie attackiert unsere Fähigkeit, uns noch mit Gegenpositionen auseinanderzusetzen. Wir wissen, woher das kommt, weil Zustimmung und Verkürzung die Klientel eben engaged halten – und weil die Plattformen Werbung verkaufen müssen. Das ist alles begründet. Aber da müsste das Bildungssystem eben reagieren und gerade jene Kulturtechniken trainieren, die von den neuen Medien nicht mehr trainiert oder sogar zerstört werden. Das wurde, was die sozialen Medien betrifft, ignoriert. Und wenn wir das nun, angesichts des Siegeszugs der KI, wieder unterlassen, ja gut, dann gibt es tatsächlich keine Rettung mehr.

Das Buch: "Sprachmaschinen. Eine Philosophie der Künstlichen Intelligenz" (C.H. Beck)